Was steckt hinter den Begriffen,- was macht die Sensor-Bauweise so besonders und wann lohnen sich die Mehrkosten? Die Hersteller werben mit allerlei Attributen ihrer Sensoren und es kann siche rnichts schaden, zu verstehen, was sich dahinter tatsächlich verbirgt. Dazu sollte man sich erst einmal darüber im Klaren sein, wie ein CMOS Sensor (Complementary Metal-Oxide-Semiconductor), zu denen gehören nämlich die "Stacked" und "Backlighted" Sensoren, grundsätzlich aufgebaut ist.

Fotodioden

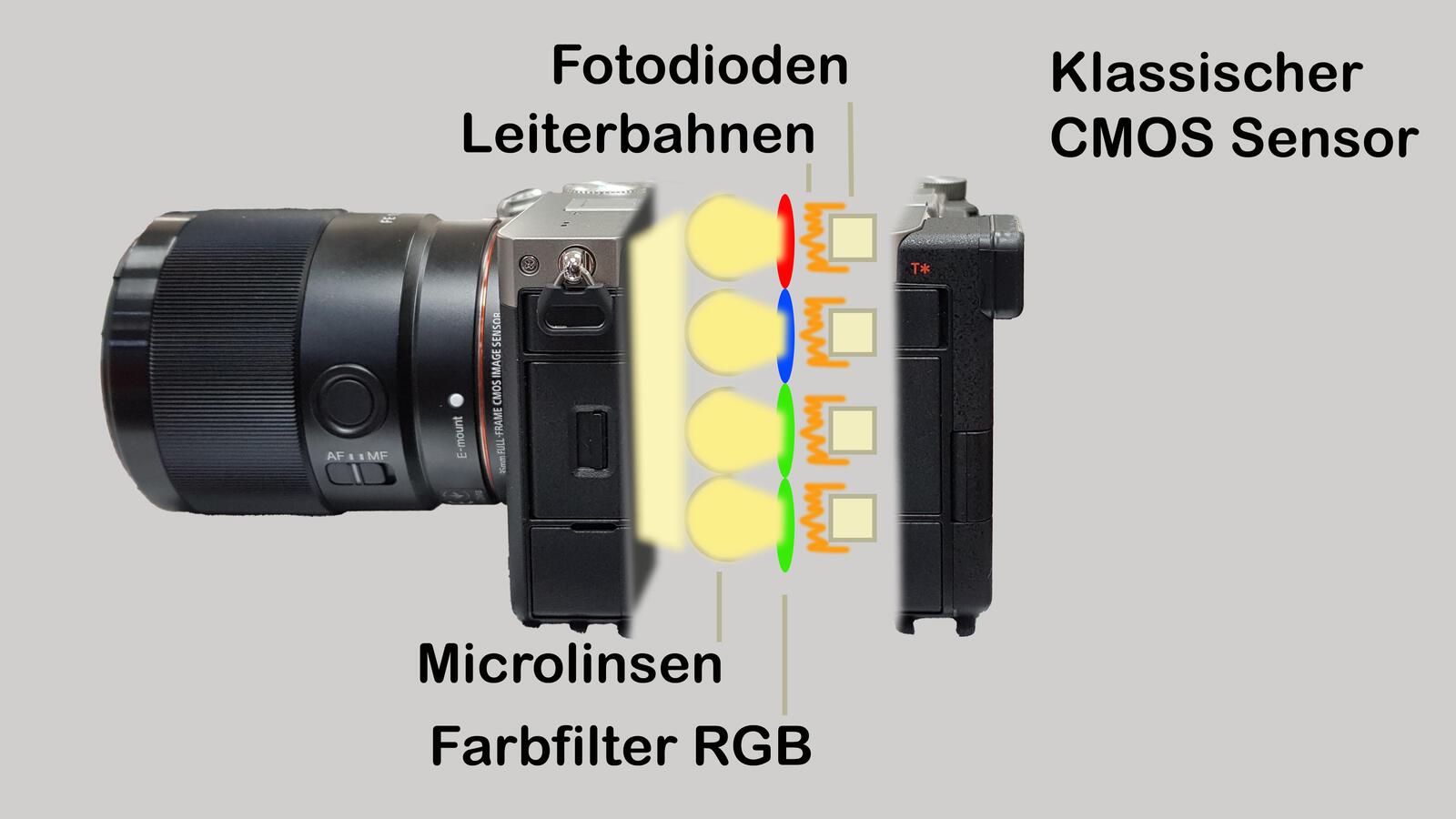

Vom Prinzip her haben wir es bei einem klassischen C-MOS Sensor (übrigens der Nachfolger der frühen CCD Sensoren) mit einer Platine oder nennen wir es besser mit einer Trägerplatte zu tun, auf deren Vorderseite sich lichtempfindliche Fotodioden zwischen denen sich Leiterbahnen und Halbleiter für die Messung, Verstärkung und Rücksetzung befinden, welche die Helligkeitsinformationen weitertransportieren an den Prozessor der Kamera.

Filter

Vor den Fotodioden befinden sich farbige Filter, sogenannte Bayer-Filter, welche die ansonsten identischen Fotodioden für eine bestimmte Farbe (Rot,Grün und Blau) sensibilisieren. Eine Fotodiode kann nämlich nur Helligkeit messen, möchte man, dass sie die Helligkeit in einem bestimmten Farbkanal misst, muss man davor einen Filter setzen. Wegen der besonderen Sensibilität des Menschen für die Farbe Grün, sind die Fotodioden zu 50% für Grün und zu jeweils 25 % für Rot und Blau sensibilisiert. Ganz praktisch sieht es dann so aus, dass für die Helligkeits,- und Farbinformationen eines Bildpixels vier Fotodioden, zwei für Grün eine für Rot und eine für Blau sensibilisiert sind.

Linsen

Und um möglichst viel Licht einfangen zu können befinden sich davor sogenannte Microlinsen, welche das Licht optimal auf jede einzelne Photodiode bündeln.

Dieses Prinzip nennt man auch Front-Illuminated, Die Tatsache, dass sich rund um die einzelne Fotodiode auch Transistoren und Leiterbahnen befinden, verringert die eigentliche Größe der Fotodiode. Das hat Nachteile unter anderem für die Lichtempfindlichkeit und macht auch den Autofokus langsamer.

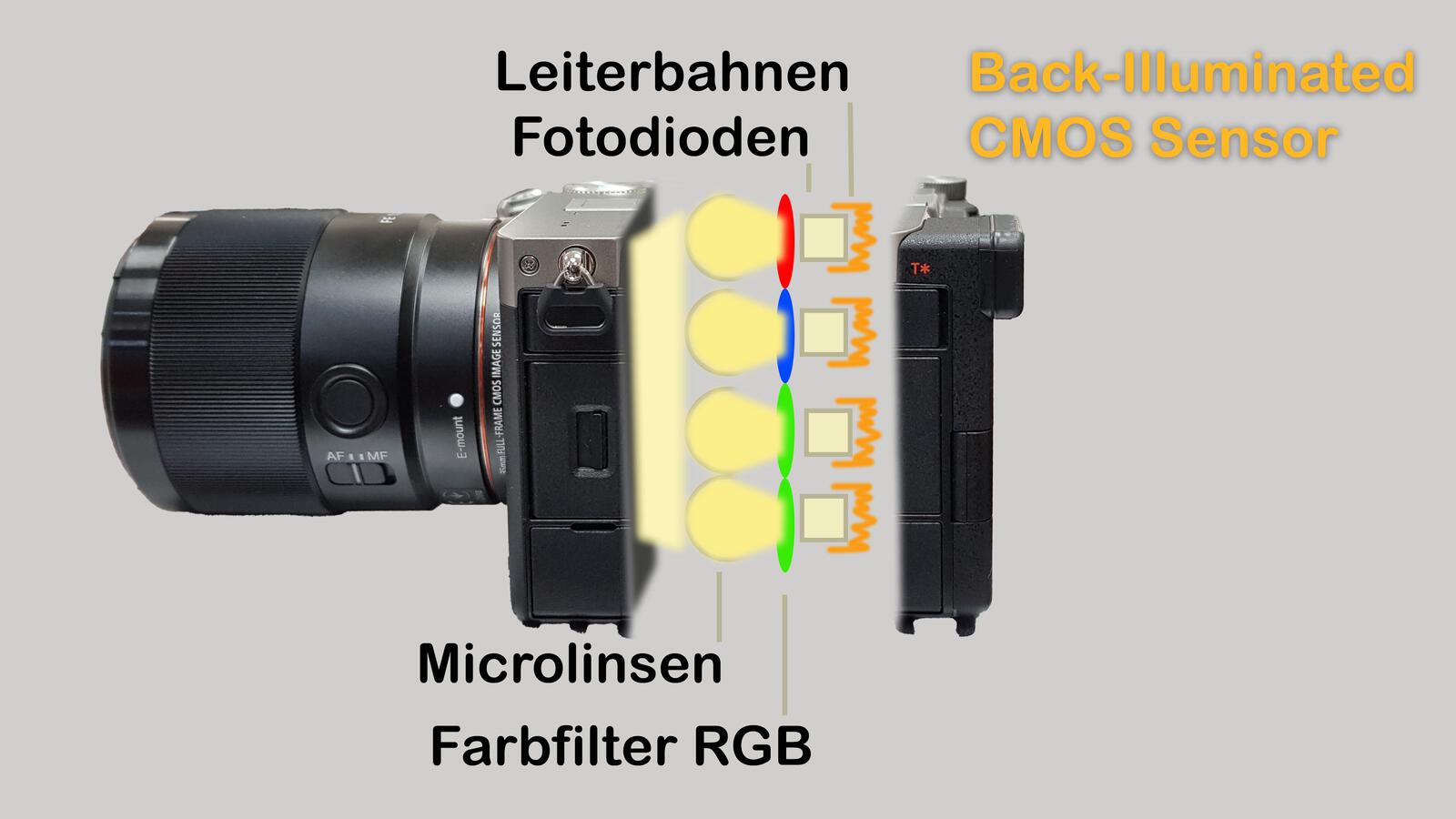

Back-Illuminated

Um diese Nachteile auszubessern, wurden die Leiterbahnen und die Transistoren zu einem geiwssen Teil unter die Fotodioden verlegt, man trennte also die Fotodioden etwas von dem Schaltkreis. Das führte dazu, dass die Fläche der einzelnen Fotodiode größer wurde und damit die Lichtempfindlichkeit und das Rauschverhalten sich verbesserten. Die Leiterbahnen für den Informationstransport liegen nicht mehr vor, sondern hinter den Fotodioden. Das beschleunigt die Geschwindigkeit, mit der die Daten ausgelesen werden können.

Aber perfekt ist das noch lange nicht, denn die einzelne Fotodiode ist dabei immer noch kleiner als das Pixel denn noch immer gbt es Transistoren rund um die eigentliche Fotodiode herum. Dies bewirkt eine gewisse Unsymmetrie, die Microlinsen können nicht einfach das Licht mittig bündeln, sondern sie müssen es seitlich ablenken. Die Bildzeilen werden nacheinander ausgelesen, was für den sogenannten Rolling Shutter Effekt verantwortlich ist.

Dieser Effekt ist allerdings nur in ganz bestimmten Situationen überhaupt erst sichtbar. Nur wenn man sehr schnell schwenkt oder die Objekte sehr schnell bewegen, kann es zu den typischen zeitlichen Verzerrungen kommen. In den allermeisten Drehsituationen wird man den rolling Shutter Effekt überhaupt nicht bemerken.

Stacked

Stacked bedeutet "gestapelt" und genau das ist bei dieser Weiterentwicklung, die es seit 2015 gibt, der Fall: Konkret werden die Sammellinsen, die Fotodioden, die A/D-Wandler und die DRAMMs auf einer Ebene hergestellt und der Bildprozessor auf einer zweiten. Diese produziert man getrennt voneinander und muss sie dann aufeinandergestapelt, also "stacked" mit höchster Präzision zusammengekleben und verlöten. Es befinden sich aber noch immer einige Bauelemente um die Fotodioden herum, die nächste Generation an "Stacked" aufgebauten Sensoren soll aber die volle Fläche für die Fotodioden nutzen.

Dieser Aufbau ermöglicht höhere Bildfrequenzen (Framerates), mehr Fotos pro Sekunde und einen besseren Autofokus. Auch der Rolling Shutter Effekt wird reduziert. Man erzielt zudem einen besseren Dynamikumfang und ein geringeres Rauschen je Pixel.

Die Herstellung ist zwar aufwändig, aber eigentlich sogar preiswerter, trotzdem werden diese Sensoren nur in sehr teuren Kameras wie der Sony A1 oder Nikons Z8 und Z9 verbaut. Nikon bietet zusätzlich noch einen Mittelweg an, teilgestapelte Sensoren bei denen die Schaltkreise nur die oberen und unteren Teile des Sensors abdecken. Die verbessern die Leistung ebenfalls und sind nicht so teuer in der Herstellung.

Geschwindigkeit

Ein wichtiger Faktor für die Qualität der Aufnahmen ist die Geschwindigkeit der Datenverarbeitung. Es klingt seltsam, aber das was die Fotodioden messen, ist eine analoge Information, die Helligkeitswerte. Diese Werte müssen zunächst einmal digitalisiert werden. Frühere Sensoren besaßen drei bis fünf Wandler pro Sensor um diese Arbeit zu leisten. Das brauchte eine Menge Zeit. Moderne Sensoren besitzen viel mehr Analog-Digital Wandler.

Ein Sensor, der 24 Millionen Pixel besitzt, hat in der Breite 6000 und in der Höhe 4000 Pixel. Für jede Spalte des Sensors gibt es nun einen eigenen Analog/Digital Wandler, also 6000 Stück. Auf diese Weise geht das Auslesen der Informationen wesentlich schneller. Trotzdem gibt es auch hier noch zeitliche Unterschiede bis die letzten Informationen eines einzelnen Bildes ausgelesen sind, folglich auch noch Rolling Shutter Effekte. Noch schnellere Sensoren besitzen deshalb jeweils zwei Wandler pro Spalte, also bezogen auf unser Beispiel insgesammt 12.000 A/D Wandler.

All das erfordert zusätzlich immer schnellere und leistungsfähigere Prozessoren in den Kameras. Um diese etwas zu entlasten, verbaut man schnelle Pufferspeicher, möglicherweise bekommen diese dann um den Fotozellen und Wandlern keinen Platz wegzunehmen, eine weitere Schicht spendiert.